ChatGPT:人工智能伦理的新挑战 (chatgpt)

简介

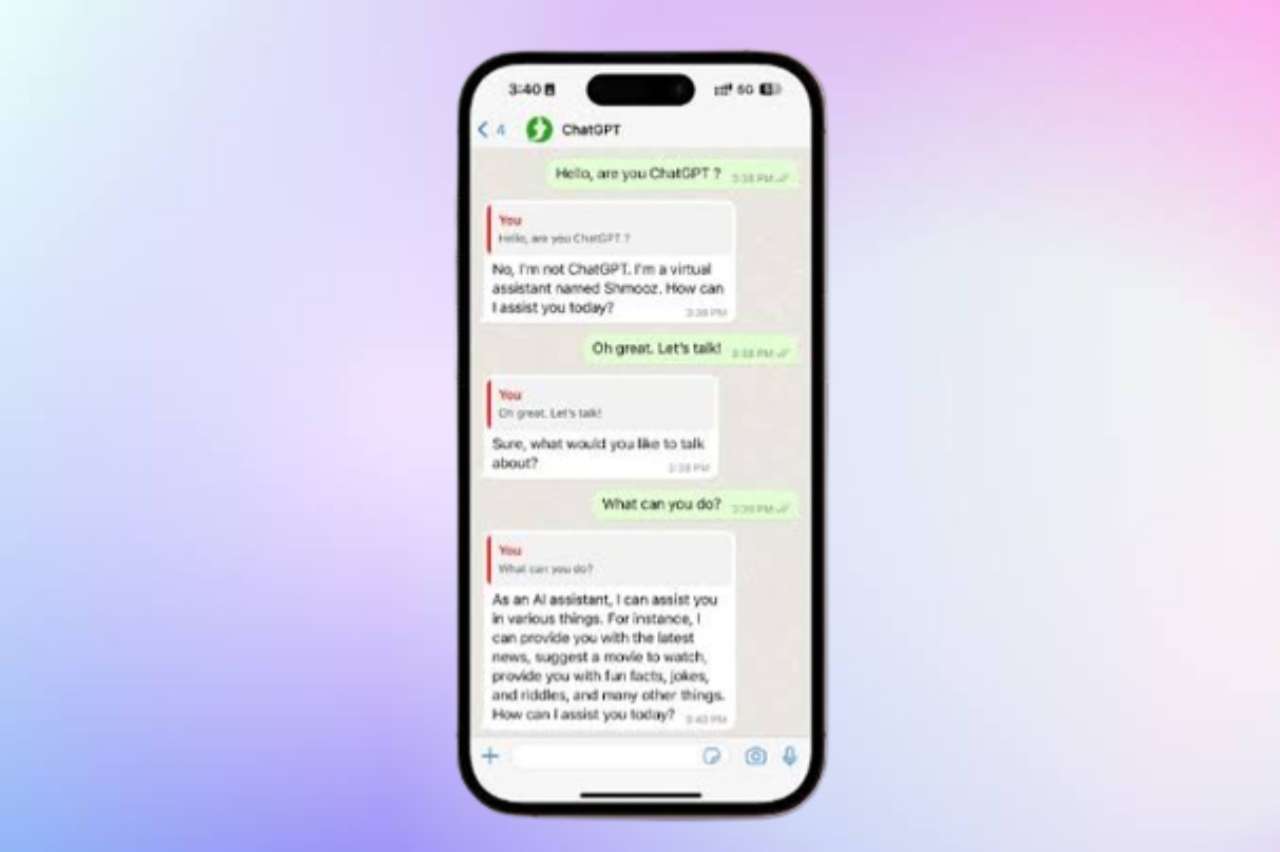

ChatGPT 是一款由 OpenAI 开发的高级人工智能模型,以其生成类人文本和参与深入对话的能力而闻名。而 ChatGPT 的能力也带来了许多伦理上的挑战。

偏见和歧视

ChatGPT 的一个主要伦理挑战是其偏见和歧视的可能性。该模型是在大量文本数据上进行训练的,这可能包括以下内容:

- 包含偏见或刻板印象的文本

- 缺乏代表性的文本,导致某些群体被低估

这可能会导致 ChatGPT 生成有偏见的或歧视性的内容,例如:

- 根据性别或种族对人进行假设

- 提出冒犯或伤害性的言论

虚假信息传播

ChatGPT 还可能无意中传播虚假信息。该模型无法区分真假信息,并且可能会生成基于错误信息或阴谋论的内容。如果用户依赖 ChatGPT 来获取信息,这可能会导致严重的错误或误解。

操纵和滥用

ChatGPT 也可以被用来操纵或滥用他人。该模型可以生成逼真的文本,这可以用来冒充他人、传播虚假信息或进行网络钓鱼攻击。这可能对个人和组织构成严重风险。

作者身份和知识产权

ChatGPT 由人工智能生成的内容提出了作者身份和知识产权的问题。该模型由多个贡献者编写,并且无法确定谁对特定部分的内容负责。这可能会导致:

- 剽窃问题的混淆

- 难以确定谁拥有内容的知识产权

Addressing Ethical Challenges

解决 ChatGPT 提出的伦理挑战至关重要。以下是实现这一目标的一些潜在方法:

-

训练偏见检测

:训练 ChatGPT 在内容中检测和消除偏见。

-

增加数据集的多样性

:使用更具包容性和代表性的数据训练 ChatGPT。

-

建立指导原则

:制定明确的准则,指导 ChatGPT 的使用,并防止其被滥用。

-

透明度和问责制

:确保用户了解 ChatGPT 内容的来源和限制,并追究其使用情况的责任。

-

教育和意识

:提高公众对 ChatGPT 伦理挑战的认识,并教育用户负责任地使用该模型。

Conclusion

ChatGPT 是一个强大的工具,但它也提出了新的伦理挑战。通过解决这些挑战,我们可以利用 ChatGPT 的潜力来改善世界,同时保护我们的价值观和人权。人工智能技术的不断发展需要我们持续地进行伦理思考和对话,以确保其负责任和符合道德地使用。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...